Automatic identification method for terrestrial wildlife in Saihanwula National Nature Reserve in Inner Mongolia of northern China based on ROI-CNN

-

摘要:目的利用红外自动感应相机对野生动物进行图像监测是对野生动物保护管理的有效手段,为了解决野外复杂背景环境导致的野生动物监测图像自动识别准确率低的问题,提出一种基于感兴趣区域(ROI)与卷积神经网络(CNN)的野生动物物种自动识别方法。方法以红外自动感应相机在内蒙古赛罕乌拉国家自然保护区内拍摄的马鹿、斑羚、猞猁、狍和野猪这5种国家级陆生保护动物的图像为实验样本,采用基于回归算法的目标检测方法,对监测图像中野生动物区域进行检测并分割,生成ROI图像,减少复杂背景信息对物种识别的干扰;利用裁剪、仿射变换等方式对样本数据进行扩充;构建基于全局-局部的VGG16双通道网络模型对样本图像进行训练,最后接入分类器输出物种识别结果。同时,构建了基于VGG19的双通道网络模型对样本图像进行训练,并与本研究训练结果进行比较;另外,将样本图像分别输入本研究算法与VGG16、R-CNN、Fast R-CNN算法进行训练,对比不同算法下的识别效果。结果利用本研究模型对样本图像进行训练时,测试集的平均识别精度均值MAP达到0.912,相对于VGG19结构下的训练模型和VGG16、R-CNN、Fast R-CNN,得到了更高的MAP值。结论相比于其他算法,本研究提出的物种识别模型更适合于复杂背景下的野生动物监测图像的物种识别,可以得到更高的MAP值与更优的识别效果。Abstract:ObjectiveThe use of infrared automatic sensing cameras for image surveillance of wildlife is an effective method for the protection and management of wildlife. In order to solve the problem of low accuracy of the automatic identification of wildlife monitoring images caused by the wild complex background environment, a method based on the region of interest (ROI) and convolutional neural network (CNN) was proposed.MethodImages of five kinds of national protected terrestrial animals such as red deer, goral, pheasant, badger, and wild boar taken in Saihanwula National Nature Reserve, Inner Mongolia of northern China by an infrared automatic sensing camera were used as experimental samples. Using target detection based on regression algorithm, the wild animal images in regional monitoring detection segmentation generated ROI images to overcome the interference of background information on wild animal identification; then perform affine transformations and cropping to achieve random sample data augmentation; proposing a global local VGG16 based on dual channel network to train sample images and use a classifier to output the recognition result finally. At the same time, a dual-channel network model based on VGG19 was constructed to train sample images and compared with the proposed model. The sample images were trained by the algorithm of this paper and VGG16, R-CNN and Fast R-CNN, respectively. The recognition results under different algorithms were compared.ResultResults showed that the mean average precision (MAP) of the test set was 0.912 compared with the other models and algorithms when sample images were trained by the model in the paper.ConclusionCompared with other algorithms, the species identification model presented in this paper is more suitable for species identification of wildlife monitoring images under complex backgrounds, and can obtain higher MAP and better recognition effects.

-

我国野生动物种类繁多,分布广泛,其中国家一级保护动物约97种,二级保护动物约320种,野生动物资源已经成为我国重要的战略资源。对野生动物进行监测是野生动物保护管理工作的重要组成,利用红外自动感应相机、无线遥感等技术[1-3]对野生动物进行图像监测是当前最有效的手段之一。这种方法可以提供野生动物的种群分布、物种多样性等信息,但是存在着人工识别效率低,监测周期长的问题。因此,采用机器学习技术对野生动物图像进行自动检测与识别成为当前的研究热点。

曾陈颖[4]提出了一种基于BP神经网络的大熊猫(Ailuropoda melanoleuca)识别方法。Okafor[5]等提出一种基于深层学习与视觉词汇袋的野生动物识别方法,该方法使用灰度、颜色信息和不同的空间汇集方法来完成训练过程。但是利用红外自动感应相机监测野生动物时,由于相机布设在野外,拍摄时易受到动物本身的行为、周围环境和气候的影响,成像条件较差,导致识别的准确率低,因此学者们开始专注于解决由复杂环境背景导致的低识别率的问题。Villa等[6]在文章中指出:图像包含的复杂背景信息对于识别的效果存在一定的影响,需要依靠准确的分割算法来提高识别准确率。Yu等[7]将动物体从待训练图像中手动提取出来,这使得其对自建数据库的识别准确率提高到82%。近些年,深度学习理论的成熟与大数据的积累,为深度学习的应用提供了实践基础[8]。在此基础上,通过应用深度学习理论构建了多种深度学习网络,并在ImageNet数据集上取得了极高的识别准确率。这些深度网络模型包括AlexNet[9]、VGG Net[10]、GoogleNet[11]、Deep Residual Net[12]和DenseNet[13]等,与此同时,这些网络模型也被用于大熊猫、长颈鹿(Giraffa camelopardalis)等野生动物[14]的图像识别。

就目前而言,深度神经网络已在动物图像的识别上广泛应用,Chen等[15]使用自动图形切割算法分割野生动物区域,再使用深度卷积神经网络对20种野生动物进行识别,得到较好的识别精度。相比其他深度网络,近年兴起的DCNN(深度卷积神经网络)直接由数据本身得到特征和表达关系的自我学习,对图像具有极强的数据特征抽象能力,因此可以适应环境变化下的对象识别。目前,DCNN已在手写字符识别[16]、行为识别[17]以及农作物识别[18-19]等方面获得了较好的效果,但是针对红外相机监测图像的检测与识别的研究仍面临着准确率低的问题。

针对以上问题,本研究提出一种基于目标检测与卷积神经网络(ROI-CNN)的野生动物监测图像的自动识别方法,通过基于回归算法的目标检测方法将野生动物所在区域从红外监测图像中分割出来,建立ROI图像数据库;将原始图像和ROI图像输入双通道卷积神经网络进行基于全局-局部的自动识别,最终实现高准确率的野生动物物种识别。

1. 材料与方法

1.1 野外环境下野生动物监测图像数据库的建立

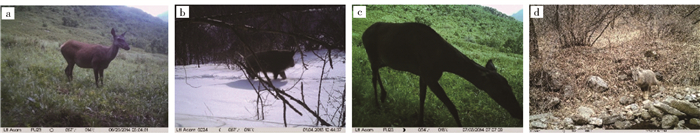

2010—2016年间,项目组在内蒙古赛罕乌拉国家级自然保护区,利用红外感应触发相机对野生动物进行图像监测,获得了上千张野生动物监测图像,构建了野生动物监测图像数据库。监测图像均为24位RGB真彩色图像,分辨率为2 560 × 1 920。本研究从中选择了5种常见的国家级陆生保护动物[20]为研究对象,包括马鹿(Cervus elaphus)、斑羚(Naemorhedus goral)、狍(Capreolus capreolus)、猞猁(Lynx lynx)和野猪(Sus scrofa)。表 1为图像数据库中5种动物的图像数量。

表 1 野生动物图像样本数据库Table 1. Wildlife image sample database图像数量

Image number马鹿

Red deer斑羚

Goral狍

Roe deer猞猁

Lynx野猪

Boar白天

Day time542 574 498 186 69 黑夜

Night time322 75 267 50 85 总图像

Total images864 649 765 236 154 红外自动感应相机在野外捕捉到的野生动物图像鲜有如图 1a所示的理想状况,监测图像通常会受到环境、动物行为和相机硬件的影响,存在如图 1b所示的遮挡问题,如图 1c、d所示的曝光以及动物颜色与背景难区分等问题,这些问题都会给图像监测中野生动物的检测与识别带来困难。

除此之外,红外自动感应相机也会因其他因素影响导致误触发拍摄大量无效图像,在训练中过大的数据量会导致检测与识别的效率低下。基于以上问题,本研究提出将ROI提取技术加入到野生动物图像的检测与识别中,减少复杂背景对动物识别的影响,同时提高模型训练的效率。

1.2 基于目标检测技术的野生动物区域自动检测分割

针对复杂背景对野生动物图像中动物的检测识别带来的影响,本研究采用一种基于回归算法的目标检测技术对图像中野生动物所在区域进行检测与分割。

回归检测算法网络DarkNet-19由19个卷积层、5个最大值池化层构成,首先将图像尺寸修改为448×448,输入网络进行预测,网络输出为S×S×(B×5+C)的张量,其中S为划分网格数,B为网络预测边框数,C为类别个数。然后将整幅图像划分为S×S个网格(grid cell),每个网格预测B个检测边界框(bounding boxes),以及每个框的置信度(confidence),每个检测边界框包含5个参数(x、y、w、h和confidence)。(x, y)代表检测边界框的中心相对其母网格的位置,(w, h)为检测边界框的宽和高。置信度confidence计算公式如下:

confidence=Pr( Object )×IOU (1) IOU=area(BBdt∩BBgt)area(BBdt∪BBgt) (2) 式中:Pr(Object)为边界框包含目标物体的概率;IOU为检测框与标准框的交并比值;BBgt为基于训练标签的参考标准框;BBdt为检测边界框;area()表示面积。

本文中使用的S=7,即将输入图像首先分为49个网格,每个网格预测2个检测边界框,在算法中每个框包含x、y、w、h、confindence这5个数值,此处仅做野生动物区域回归,不做物种的具体类别预测,因此C取1,最后的输出是7×7×(2×5+1)的张量。采用误差平方和作为损失函数(loss):

loss=λ coord S2∑i=0B∑j=0Iobjij[(xi−ˆxi)2+(yi−ˆyi)2]+λ coord S2∑i=0B∑j=0Iobjij[(√wi−√ˆwi)2+(√hi−√hi)2] (3) 式中:λcoord为定位误差的权重;xi、yi、wi、hi是第i个网格的位置以及宽和高;ˆxi,ˆyi,ˆwi,ˆhi是参考标准框的参数值。Iijobj表示第i个网格中第j个负责预测的预测值(predictor)。

在每一张图像中,会存在很多并不包含物体的网格,这些网格的置信度为0,它们的训练梯度远大于包含物体中心的部分网格,很可能会覆盖掉它们的梯度更新,使得模型不稳定,导致网络的发散。针对这个问题,本研究给定位误差更大的权重,使λcoord=5,同时减小不包含物体中心网格的置信度误差的权重,包含物体中心网格的置信度误差则保持不变。

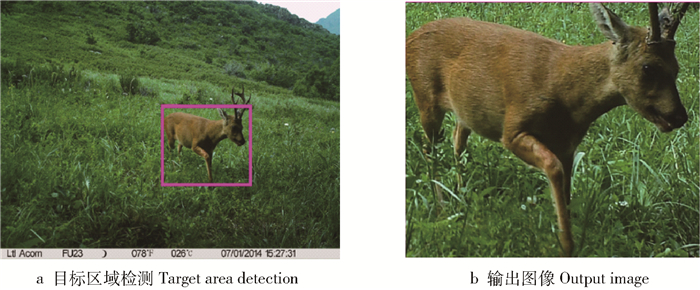

按照检测得到的野生动物所在区域的坐标(包含左上角坐标[x1, y1]和右下角坐标[x2, y2])对图像(图 2a)进行切割,输出如图 2b的目标区域图像,建立ROI图像库,为下一步的野生动物的自动识别提供数据基础。为了更精确地提取目标物种的特征,本研究需要目标检测算法的准确率达到90%以上才可进行后续的模型训练。

1.3 基于VGG16的训练网络

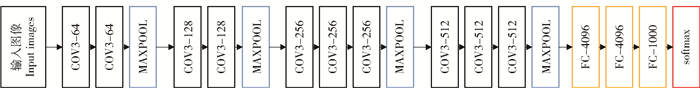

VGGNet是DCNN的典型代表,其3×3小卷积核的设计思想使得网络的参数更少,且在具有1 000个分类的大规模图像数据集ImageNet[21]的分类和定位上的适用性已得到了充分的验证,因此本研究以此为基础设计针对野生动物监测图像的识别网络。图 3为16个权重层的网络结构。

![]() 图 3 VGG16网络架构注:COV3-64表示卷积核大小为3 × 3,通道数为64的卷积层;COV3-128表示卷积核大小为3 × 3,通道数为128的卷积层;COV3-256表示卷积核大小为3 × 3,通道数为256的卷积层;COV3-512表示卷积核大小为3 × 3,通道数为512的卷积层;MAXPOOL表示采用最大值池化;FC-4096表示通道数为4096的全连接层;FC-1000表示通道数为1000的全连接层;分类层采用softmax函数。Figure 3. VGG16 network architectureNotes: COV3-64 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 64 channels. COV3-128 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 128 channels. COV3-256 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 256 channels. COV3-512 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 512 channels. MAXPOOL indicates that the maximum pool is used.FC-4096 denotes a fully connected layer with a channel number of 4096. FC-1000 denotes a fully connected layer with a channel number of 1000;the classification layer uses softmax function.

图 3 VGG16网络架构注:COV3-64表示卷积核大小为3 × 3,通道数为64的卷积层;COV3-128表示卷积核大小为3 × 3,通道数为128的卷积层;COV3-256表示卷积核大小为3 × 3,通道数为256的卷积层;COV3-512表示卷积核大小为3 × 3,通道数为512的卷积层;MAXPOOL表示采用最大值池化;FC-4096表示通道数为4096的全连接层;FC-1000表示通道数为1000的全连接层;分类层采用softmax函数。Figure 3. VGG16 network architectureNotes: COV3-64 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 64 channels. COV3-128 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 128 channels. COV3-256 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 256 channels. COV3-512 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 512 channels. MAXPOOL indicates that the maximum pool is used.FC-4096 denotes a fully connected layer with a channel number of 4096. FC-1000 denotes a fully connected layer with a channel number of 1000;the classification layer uses softmax function.VGGNet的输入为224×224的RGB图像,图像经过网络的处理,输出其属于每个类别的概率。VGGNet架构的核心由卷积层和池化层交替构成。其中前5部分分别由多个卷积核大小为3×3的卷积层构成,第6部分为3个全连接(fully-connected, FC)层。卷积层的主要作用是提取特征[22],即包含一组经数据驱动进行自主学习的卷积核,又称特征提取器。针对不同的特征提取密集度,卷积核用固定大小的卷积步幅与输入做卷积运算,经由激活函数变换后构成卷积特征图,代表对输入图像特征的响应。输出的特征图通常表示为:

aln=f(∑∀m(al−1m×klm,n)+bln) (4) 式中:anl为第l层(当前层)的第n个特征图,aml-1为第(l-1)层(上一层)的第m个特征图,km, nl表示作用于2个特征图之间的卷积核,f(x)为激活函数,bnl代表偏置项。

池化层用于特征映射和降维,本研究中采用最大值池化,对卷积特征图进行下采样后构成池化特征图,通常表示为:

aln=f(rln×1s2∑s×sal−1n+bln) (5) 式中:s是选取的下采样模板,rnl为模板的权值。

经过多层级联后,全连接层对最后一个池化层输出的特征图作矢量变换,构成特征向量输送到分类层。

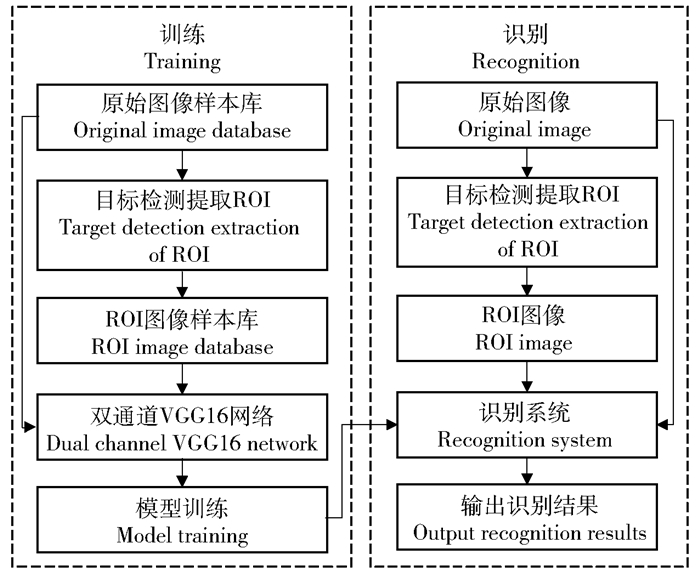

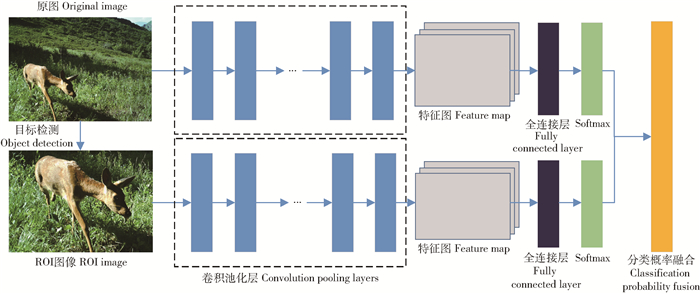

2. 基于全局-局部的双通道VGG16野生动物自动识别

基于上文提到的技术与方法,提出一种基于ROI-CNN的野生动物监测图像自动识别方法,首先采用基于回归算法的目标检测技术对图像中野生动物所在的区域进行检测,实现自动的分割与裁剪,得到以动物为主体的图像集(ROI图像);提出一种双通道模型,将未经感兴趣区域提取的图像和ROI图像同时导入VGGNet进行训练,基于ImageNet数据库进行微调,最后接入分类器输出最终的识别结果。图 4为算法流程图。

图 5所示为构建的基于VGG16的双通道网络模型,其中包括网络通道G1与网络通道G2。将未经感兴趣区域提取的图像数据库与经感兴趣区域提取后的ROI图像数据库作为训练样本,分别输入G1与G2,以softmax作为分类器,分别输出预测概率矩阵PG1与PG2:

\boldsymbol{P}_{\mathrm{G} 1}=\left[P_{1\_1}, P_{1\_2}, P_{1\_3}, P_{1\_4}, P_{1\_5} \right] (6) \boldsymbol{P}_{\mathrm{G} 2}=\left[P_{2\_1}, P_{2\_2}, P_{2\_3}, P_{2\_4}, P_{2\_5}\right] (7) 式中:Pi_j表示网络输出的预测概率,i∈{1,2},分别对应网络通道G1与G2;j∈{1,2,3,4,5},分别对应5种被预测的物种。PG1与PG2为n=5的行向量,概率矩阵满足各类预测概率之和为1,即满足:

\sum\limits_{j=1}^{5} P_{i j}=1 (8) 最后通过分类概率融合将概率矩阵PG1与PG2相加取平均值,得到最终的识别概率矩阵Q,并输出矩阵中概率最大值所对应的物种作为识别的结果。

Q=\frac{\boldsymbol{P}_{\mathrm{G} 1}+\boldsymbol{P}_{\mathrm{C} 2}}{2} (9) 3. 实验和结果分析

本研究的硬件平台为E5-2620 CPU,两块GTX 1080ti GPU的工作站,软件为Ubuntu16.04操作系统、Python2.7的编程环境、Tensorflow1.3.0的深度学习框架。

3.1 野生动物目标检测器训练

首先采用1.2节介绍的基于回归的目标检测技术训练野生动物目标检测器。从样本库中随机选择每类野生动物图片的80%作为训练样本,使用labelImg作为图像标定软件,对训练集图像中的野生动物区域进行人工标定。以Darknet-19作为特征提取网络,采用随机梯度下降法(SGD)为优化函数,初始学习率为0.001,冲量(momentum)为0.9,训练批次(batch size)为8。训练过程迭代次数为1 200次,图 6为训练准确率的变化图。训练集准确率在训练迭代1 200次后达到97%以上,将数据库中其余20%的样本作为验证集,最终验证集准确率为96.6%。这说明野生动物目标检测器满足90%的准确率要求,可以用来提取监测图像中野生动物所在区域。

3.2 双通道卷积神经网络模型训练

训练VGG16网络模型时,采用随机梯度下降(stochastic gradient descent, SGD)算法进行优化实验,学习率采用步进阶梯调节策略step。网络模型训练参数如表 2所示。

表 2 网络模型训练参数Table 2. Training parameters of the network model参数类型

Parameter type批量数据

Batch data优化算法

Optimization algorithm初始学习率

Initial learning rate迭代次数

Epochs损失函数

Loss function值或方法Value or method 64 随机梯度下降

Stochastic gradient descent0.001 50 交叉熵函数Cross entropy function 为了丰富图像训练集,更好地提取图像特征,提高模型泛化能力,本研究在训练过程中采用仿射变换和裁剪等方式对样本图像进行数据扩充,将原有训练样本数据扩充5倍。将图像数据库中的每类野生动物图像分成训练集、测试集和验证集。其中训练集和测试集分别占每类动物图像总数的70%和30%,随机从图像数据库中产生20%作为验证集。

选定平均识别精度的平均值MAP[23](mean average precision)来评价识别模型的好坏,MAP的计算公式如式(10):

\operatorname{MAP}=\frac{\sum\limits_{q=1}^{5} \operatorname{Ave} P(q)}{5} (10) 式中:q为野生动物物种的编号,P(q)为野生动物监测图像中第q类物种的识别精度,AveP(q)为第q类物种的平均识别精度(average precision,AP),MAP为5种物种的平均识别精度的均值。

3.3 不同CNN网络结构的对比实验

本研究算法中采用的网络结构是VGG16,为了验证不同网络结构对算法识别效果的影响,用VGG19结构代替VGG16进行训练识别,将两种结构下的训练效果进行对比。

图 7所示为两种结构下的模型在训练时损失函数值和准确率随迭代次数的变化,两种模型的训练均在40次迭代之后开始趋于稳定。对5种野生动物的识别效果以及训练的MAP值和验证时最大MAP值的对比如表 3所示。

表 3 不同物种的AP值与不同模型的MAP值Table 3. AP value of different species and MAP value of varied models算法类别

Algorithm classAP MAP(测试)

MAP(test)最大MAP(验证)

Max. MAP(validation)马鹿

Red deer斑羚

Goral狍

Roe deer猞猁

Lynx野猪

BoarVGG19 0.87 0.82 0.82 0.83 0.81 0.83 0.87 本研究算法Algorithm in this research 0.94 0.91 0.91 0.88 0.92 0.91 0.94 注:AP代表平均识别精度,MAP代表平均识别精度的均值。Notes: AP is average identification precision, and MAP is mean AP. 表 3中,2~6列为不同物种测试集的平均识别精度AP,第7列为测试集5种物种的平均识别精度的均值MAP,第8列为训练过程中,验证集的最大MAP值。综合分析图 7和表 3可得:1)无论采用哪种结构,验证时的最大MAP值和测试时的MAP值相差较小,说明模型没有产生欠拟合或者过拟合的问题;2)训练时,相比于VGG19结构,VGG16结构下的损失函数值下降更快,稳定后的损失函数值更低,训练效率较高;3)两种结构下的测试准确率差值较小,但是VGG16结构下的测试准确率始终高于VGG19;4)针对研究中这5种野生动物,VGG16结构下的模型识别效果均优于VGG19,且最高的准确率差值达到11%;5)验证时,VGG16结构的最大MAP值为0.94,而VGG19结构的最大MAP值仅为0.87。

VGG19网络相较于VGG16虽然具有更深的网络层数,但网络层数越深,网络反向传播的梯度相关性越差,造成梯度弥散现象,所以并非网络层数越深,识别效果越优。综上所述,本研究采用VGG16结构的模型,使得训练效果更优,训练效率更高,能够得到更高的MAP值,更加适合于红外自动感应相机下野生动物监测图像的物种识别。

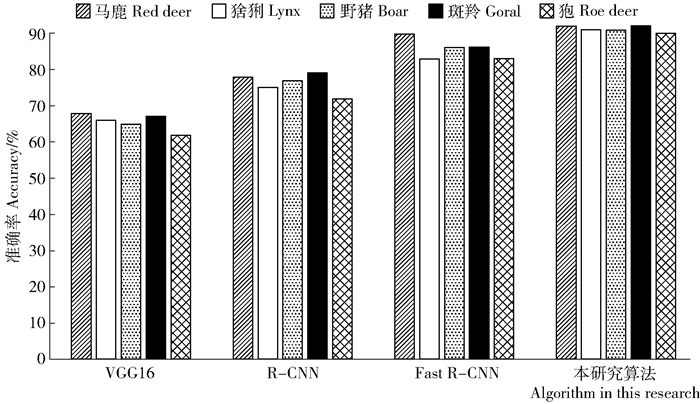

3.4 算法性能评估实验

R-CNN、Fast R-CNN[24]是DCNN初期应用算法中的主流方法,其思想也影响了目前大量的检测模型网络。R-CNN的核心思想是从输入图像中选出上千个候选框,对每个候选框做卷积运算以及特征提取,再使用分类器判别其类别;而Fast R-CNN则是只对输入图像做一次卷积运算得到特征图,找到每个候选框在特征图上的映射,再提取出特征输入分类器进行判别。这两种算法都是在输入图像上划分出大量的候选框进行处理,本研究算法则是对输入图像进行处理,分割出目标所在的区域,再进行之后的模型训练以及识别分类。为了证明本研究提出算法的有效性,在野生动物监测图像集上,分别利用4种算法对5种野生动物进行物种识别,图 8所示为不同算法准确率的对比,其MAP值的对比如表 4所示。

表 4 不同算法的MAPTable 4. MAP of different algorithms算法类别

Algorithm classVGG16 R-CNN Fast R-CNN 本研究算法

Algorithm in this research最大MAP(验证)

Max.MAP(validation)0.672 0.803 0.895 0.931 MAP(测试)

MAP(test)0.656 0.762 0.856 0.912 综合分析图 8、表 4可得:1)训练时,针对5种野生动物,本研究算法的训练效果相比于VGG16、R-CNN与Fast R-CNN均为最佳,测试时MAP的值也最高;2)与单独的VGG16结构相比,本研究算法对5种野生动物的测试准确率均高出20%以上,验证时的最大MAP值高出0.259,证明对图像进行ROI提取能够降低复杂背景信息对图像识别的影响,得到更好的识别效果;3)对于狍的准确率,本研究算法比R-CNN的准确率高出18%,狍的图像质量较差,动物本身与背景经常难以区分,说明本研究算法比R-CNN更好地减少了背景对图像识别的影响;4)与Fast R-CNN的表现相比,由于马鹿图像质量较好,大多比较清晰、辨识度高,受背景影响较小,本研究算法在马鹿的识别上仅高出2%,相比之下,背景更为复杂的猞猁、野猪、斑羚和狍图像的识别上,本研究算法的准确率就比Fast R-CNN提高了8%、5%、6%、7%,也说明了本研究算法在处理背景复杂的图像上优于Fast R-CNN,能够达到更高的识别准确率;5)验证时,本研究算法的最大MAP值最大,VGG16的最小,与识别效果的比较关系相对应,且对于4种算法,验证时的最大MAP值和测试时的MAP值的差值均较小,再次证明训练没有产生过拟合的问题。

综上所述,与VGG16、R-CNN与Fast R-CNN相比,本研究算法在马鹿、猞猁、野猪、斑羚和狍的红外相机监测图像的检测与识别上具有更高的精度,图像初期的检测分割处理减少了无效背景的影响,对于树木遮挡、光线变化有较好的鲁棒性,更加满足野生动物监测图像识别的要求。

4. 结论

针对红外自动感应相机在野外环境下拍摄的野生动物监测图像,提出一种基于ROI-CNN的图像自动识别方法,利用基于回归算法的目标检测与全局-局部的双通道卷积神经网络,有效克服复杂背景信息对野生动物监测图像物种识别的干扰。通过实验分析,采用VGG16作为卷积网络的测试准确率最高,对内蒙古赛罕乌拉国家级自然保护区内5种陆生野生动物的平均识别率均可达到90%左右。为了验证本研究算法的有效性,设计了与VGG16、R-CNN、Fast R-CNN算法的对比试验,与5种野生动物的测试准确率和MAP值进行对比,实验结果表明:针对全部5种野生动物,本研究提出算法的测试准确率最高,达到更高的测试MAP值,识别效果最优。

-

图 3 VGG16网络架构

注:COV3-64表示卷积核大小为3 × 3,通道数为64的卷积层;COV3-128表示卷积核大小为3 × 3,通道数为128的卷积层;COV3-256表示卷积核大小为3 × 3,通道数为256的卷积层;COV3-512表示卷积核大小为3 × 3,通道数为512的卷积层;MAXPOOL表示采用最大值池化;FC-4096表示通道数为4096的全连接层;FC-1000表示通道数为1000的全连接层;分类层采用softmax函数。

Figure 3. VGG16 network architecture

Notes: COV3-64 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 64 channels. COV3-128 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 128 channels. COV3-256 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 256 channels. COV3-512 represents a convolution layer with a convolutional kernel of 3×3 and a convolutional layer with 512 channels. MAXPOOL indicates that the maximum pool is used.FC-4096 denotes a fully connected layer with a channel number of 4096. FC-1000 denotes a fully connected layer with a channel number of 1000;the classification layer uses softmax function.

表 1 野生动物图像样本数据库

Table 1 Wildlife image sample database

图像数量

Image number马鹿

Red deer斑羚

Goral狍

Roe deer猞猁

Lynx野猪

Boar白天

Day time542 574 498 186 69 黑夜

Night time322 75 267 50 85 总图像

Total images864 649 765 236 154 表 2 网络模型训练参数

Table 2 Training parameters of the network model

参数类型

Parameter type批量数据

Batch data优化算法

Optimization algorithm初始学习率

Initial learning rate迭代次数

Epochs损失函数

Loss function值或方法Value or method 64 随机梯度下降

Stochastic gradient descent0.001 50 交叉熵函数Cross entropy function 表 3 不同物种的AP值与不同模型的MAP值

Table 3 AP value of different species and MAP value of varied models

算法类别

Algorithm classAP MAP(测试)

MAP(test)最大MAP(验证)

Max. MAP(validation)马鹿

Red deer斑羚

Goral狍

Roe deer猞猁

Lynx野猪

BoarVGG19 0.87 0.82 0.82 0.83 0.81 0.83 0.87 本研究算法Algorithm in this research 0.94 0.91 0.91 0.88 0.92 0.91 0.94 注:AP代表平均识别精度,MAP代表平均识别精度的均值。Notes: AP is average identification precision, and MAP is mean AP. 表 4 不同算法的MAP

Table 4 MAP of different algorithms

算法类别

Algorithm classVGG16 R-CNN Fast R-CNN 本研究算法

Algorithm in this research最大MAP(验证)

Max.MAP(validation)0.672 0.803 0.895 0.931 MAP(测试)

MAP(test)0.656 0.762 0.856 0.912 -

[1] Bracciale L, Catini A, Gentile G, et al. Delay tolerant wireless sensor network for animal monitoring: the pink iguana case[C]//Proceedings of international conference on applications in electronics pervading industry, environment and society. Cham: Springer, 2016: 18-26.

[2] 陈善安, 胡春鹤, 张军国, 等.基于无线传感器网络的野生动物图像监测系统设计[J].现代制造技术与装备, 2017(3): 64-66. doi: 10.3969/j.issn.1673-5587.2017.03.030 Chen S A, Hu C H, Zhang J G, et al. Design of wildlife image monitoring system based on wireless sensor networks[J]. Modern Manufacturing Technology and Equipment, 2017(3): 64-66. doi: 10.3969/j.issn.1673-5587.2017.03.030

[3] Oishi Y, Matsunaga T. Automatic detection of moving wild animals in airborne remote sensing images[C]//2010 IEEE international geoscience and remote sensing symposium. Honolulu: IEEE, 2010: 517-519.

[4] 曾陈颖.面向珍稀野生动物保护的图像监测与识别技术研究[D].北京: 北京林业大学, 2015. Zeng C Y. Research of image monitoring and identification oriented to rare wild animals protection[D]. Beijing: Beijing Forestry University, 2015.

[5] Okafor E, Pawara P, Karaaba F, et al. Comparative study between deep learning and bag of visual words for wild-animal recognition[C]//2016 IEEE symposium series on computational intelligence (SSCI). Athens: IEEE, 2017: 1-9.

[6] Villa A G, Salazar A, Vargas F. Towards automatic wild animal monitoring: identification of animal species in camera-trap images using very deep convolutional neural networks[J]. Ecological Informatics, 2017, 41: 24-32. doi: 10.1016/j.ecoinf.2017.07.004

[7] Yu X Y, Wang J P, Kays R, et al. Automated identification of animal species in camera trap images[J]. EURASIP Journal on Image and Video Processing, 2013, 2013: 52. doi: 10.1186/1687-5281-2013-52

[8] 李力, 林懿伦, 王飞跃, 等.平行学习—机器学习的一个新型理论框架[J].自动化学报, 2017, 43(1): 1-8. doi: 10.3969/j.issn.1003-8930.2017.01.001 Li L, Lin Y L, Wang F Y, et al. Parallel learning: a new framework for machine learning[J]. Acta Automatica Sinica, 2017, 43(1): 1-8. doi: 10.3969/j.issn.1003-8930.2017.01.001

[9] Krizhevsky A, Sutskever I, Hinton G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of international conference on neural information processing systems. Lake Tahoe: Curran Associates Inc., 2012: 1097-1105.

[10] Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition[J]. Computer Science, 2014: 23-31. doi: 10.5121/csit.2014.41000

[11] Szegedy C, Liu W, Jia Y Q, et al. Going deeper with convolutions[C]//Proceedings of 2015 IEEE conference on computer vision and pattern recognition (CVPR). Boston: IEEE, 2015: 1-9.

[12] He K M, Zhang X Y, Ren S Q, et al. Deep residual learning for image recognition[C]//Proceedings of 2016 IEEE conference on computer vision and pattern recognition (CVPR). Las Vegas: IEEE, 2016: 770-778.

[13] Huang G, Liu Z, Van Der Maaten L, et al. Densely connected convolutional networks[C]//Proceedings of 2017 IEEE conference on computer vision and pattern recognition. Honolulu: IEEE, 2017.

[14] Figueroa K, Camarena-Ibarrola A, García J, et al. Fast automatic detection of wildlife in images from trap cameras[M]//Bayro-Corrochano E, Hancock E. Progress in pattern recognition, image analysis, computer vision, and applications. Cham: Springer, 2014: 940-947.

[15] Chen G B, Han T X, He Z H, et al. Deep convolutional neural network based species recognition for wild animal monitoring[C]//Proceedings of 2014 IEEE international conference on image processing (ICIP). Paris: IEEE, 2015: 858-862.

[16] Yang W X, Jin L W, Tao D C, et al. DropSample: a new training method to enhance deep convolutional neural networks for large-scale unconstrained handwritten Chinese character recognition[J]. Pattern Recognition, 2016, 58: 190-203. doi: 10.1016/j.patcog.2016.04.007

[17] 王忠民, 曹洪江, 范琳.一种基于卷积神经网络深度学习的人体行为识别方法[J].计算机科学, 2016, 43(增刊2): 56-58, 87. http://d.old.wanfangdata.com.cn/Periodical/jsjkx2016z2012 Wang Z M, Cao H J, Fan L. Method on human activity recognition based on convolutional neural networks[J]. Computer Science, 2016, 43(Suppl.2): 56-58, 87. http://d.old.wanfangdata.com.cn/Periodical/jsjkx2016z2012

[18] 高震宇, 王安, 刘勇, 等.基于卷积神经网络的鲜茶叶智能分选系统研究[J].农业机械学报, 2017, 48(7): 53-58. http://d.old.wanfangdata.com.cn/Periodical/nyjxxb201707007 Gao Z Y, Wang A, Liu Y, et al. Intelligent fresh-tea-leaves sorting system research based on convolution neural network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(7): 53-58. http://d.old.wanfangdata.com.cn/Periodical/nyjxxb201707007

[19] 吴笑鑫, 高良, 闫民, 等.基于多特征融合的花卉种类识别研究[J].北京林业大学学报, 2017, 39(4): 86-93. doi: 10.13332/j.1000-1522.20160367 Wu X X, Gao L, Yan M, et al. Flower species recognition based on fusion of multiple features[J]. Journal of Beijing Forestry University, 2017, 39(4): 86-93. doi: 10.13332/j.1000-1522.20160367

[20] 那顺得力格尔.内蒙古赛罕乌拉国家级自然保护区陆生野生动物保护监测研究[D].北京: 北京林业大学, 2011. Nasendeleger. Monitoring on wildlife biodiversity at Saihanwula National Nature Reserve[D]. Beijing: Beijing Forestry University, 2011.

[21] Russakovsky O, Deng J, Su H, et al. ImageNet large scale visual recognition challenge[J]. International Journal of Computer Vision, 2015, 115(3): 211-252. doi: 10.1007/s11263-015-0816-y

[22] 杨国国, 鲍一丹, 刘子毅.基于图像显著性分析与卷积神经网络的茶园害虫定位与识别[J].农业工程学报, 2017, 33(6): 156-162. http://d.old.wanfangdata.com.cn/Periodical/nygcxb201706020 Yang G G, Bao Y D, Liu Z Y. Localization and recognition of pests in tea plantation based on image saliency analysis and convolutional neural network[J]. Transactions of the Chinese Society of Agricultural Engineering, 2017, 33(6): 156-162. http://d.old.wanfangdata.com.cn/Periodical/nygcxb201706020

[23] 谢将剑, 李文彬, 张军国, 等.基于Chirplet语图特征和深度学习的鸟类物种识别方法[J].北京林业大学学报, 2018, 40(3): 122-127. doi: 10.13332/j.1000-1522.20180008 Xie J J, Li W B, Zhang J G, et al. Bird species recognition method based on Chirplet spectrogram feature and deep learning[J]. Journal of Beijing Forestry University, 2018, 40(3): 122-127. doi: 10.13332/j.1000-1522.20180008

[24] Girshick R. Fast R-CNN[C]//Proceedings of IEEE international conference on computer vision (ICCV). Santiago: IEEE, 2015: 1440-1448.

-

期刊类型引用(13)

1. 柯澳,王宇聪,胡博宇,林琦,李勇,双丰. 基于图像的野生动物检测与识别综述. 计算机系统应用. 2024(01): 22-36 .  百度学术

百度学术

2. 陈明,王善勤. 基于改进YOLOv5s算法和自适应决策的野猪检测方法. 湖南工业职业技术学院学报. 2024(04): 19-24 .  百度学术

百度学术

3. 杨帆. 基于人工智能下的野生动物识别研究与应用. 中国高新科技. 2024(16): 72-74 .  百度学术

百度学术

4. 杨拂晓,费龙,闫泰辰. 基于深度学习的野生动物图像识别研究综述. 北京测绘. 2024(09): 1237-1242 .  百度学术

百度学术

5. 戴天虹,刘超. 基于改进EfficientDet的雪豹红外相机图像检测方法. 哈尔滨理工大学学报. 2023(02): 108-116 .  百度学术

百度学术

6. 杨雪珂,蒙金超,冯悦恒,林婷婷,王兆君,刘辉. 基于残差卷积神经网络模型的勺嘴鹬动作识别. 热带生物学报. 2023(05): 481-489 .  百度学术

百度学术

7. 齐建东,马鐘添,张德怀,田赟. 基于BS-ResNeXt-50的密云地区野生动物图像识别. 林业科学. 2023(08): 112-122 .  百度学术

百度学术

8. 杨琴,安见才让. 遮挡条件下的动物目标检测方法研究进展. 信息技术与信息化. 2023(12): 189-192 .  百度学术

百度学术

9. 王翰霖,文帅,白俊,李东睿,罗概,林玉成. 红外相机监测目标物种的一种自动化检测方法:以绿尾虹雉为例. 四川动物. 2022(04): 361-369 .  百度学术

百度学术

10. 李艳杰,召玉龙. 自然保护区亚洲象活动行为监测方法研究. 绿色科技. 2021(22): 63-64+79 .  百度学术

百度学术

11. 陈建促,王越,朱小飞,李章宇,林志航. 融合多特征图的野生动物视频目标检测方法. 计算机工程与应用. 2020(07): 221-227 .  百度学术

百度学术

12. 谢将剑,杨俊,邢照亮,张卓,陈新. 多特征融合的鸟类物种识别方法. 应用声学. 2020(02): 199-206 .  百度学术

百度学术

13. 宫一男,谭孟雨,王震,赵国静,蒋沛林,蒋仕铭,张鼎基,葛剑平,冯利民. 基于深度学习的红外相机动物影像人工智能识别:以东北虎豹国家公园为例. 兽类学报. 2019(04): 458-465 .  百度学术

百度学术

其他类型引用(20)

下载:

下载: