Flower species recognition based on fusion of multiple features

-

摘要: 花卉种类识别作为植物自动分类识别的重要分支,有着很高的研究和应用价值。针对当前花卉特征描述存在的局限和花卉识别准确率较低的实际情况,以花卉图像为研究对象,首先对复杂背景图像采用基于显著性检测的Grab Cut分割算法进行预处理,得到单一背景图像;然后在提取花卉图像花冠(所有花瓣)颜色和形状特征的基础上,创新性地提取花蕊区域的颜色和形状所包含的特征信息,并将提取到的18个特征融合成单一特征向量。以支持向量机(SVM)算法为基础构建分类器,通过实验确定核函数与最佳参数;对360幅自建花卉样本库(24个种类,每个种类15幅)进行训练和测试,其中240幅作为训练样本,120幅作为测试样本,并与基于不同特征组合的识别方法进行比较。结果表明:本文提出的基于多特征融合的识别方法具有较高的识别准确率,识别率可以达到92.50%。对通用花卉样本库Oxford 17 flower进行训练与测试,选取其中340幅作为训练样本,170幅作为测试样本,取得了较好的识别效果,验证了本文方法的有效性。Abstract: As an important branch of plant automatic classification and recognition, flower species recognition is of great value in academic research and practical application. In view of the limitation of description methods for flower features and the problem of low accuracy of flower species recognition, flower images were used as recognition objects, the segmentation algorithm of Grab Cut based on saliency detection was used to preprocess the images with complex background and the images with single background were got. Then the color and shape features of the flower region were extracted. In addition to the color and shape features of the whole flower region, the color and shape features of the pistil/stamen area were also used to represent the flower characteristics more precisely. At last the 18 features were fused into a single feature vector and the SVM (support vector machine) was used for classification and recognition. Experiment based on self-built flower library was conducted for 360 images (15 images each for 24 different species), 240 images were used for the training samples, and the rest of 120 images were used for the test samples. Compared with the recognition methods based on the combination of different features, the method provided in this paper has achieved better recognition effect.The experimental results showed that the recognition accuracy reached 92.50%. Experiments based on Oxford 17 flower library were conducted for 510 images, in which 340 images were used for the training samples, and 170 images were used for the test samples. The experimental results show that the proposed method is effective.

-

在植物信息学领域,植物的分类与识别是一项重要的基础工作。随着数码相机和智能手机等移动图像获取终端的普及,采集花卉图像变得十分便捷,人们可通过计算机技术对花卉图像进行分析处理,从而识别植物种类。在分类识别领域,花卉种类识别逐渐成为植物自动识别的重要分支。

花卉种类识别属于精细图像分类的范畴,是当前分类识别的研究热点之一。在国内,柯逍等[1]采用标注矩阵与RGB相结合的方法实现图像分割,并采用基于SVM分类器的多特征融合方法进行花卉图像的识别;周伟等[2]将显著图融入到图像特征的提取过程中,采用SVM分类器进行花卉图像识别,并没有充分考虑花卉图像的形状特征;张娟等[3]提取梅花的颜色、形状和纹理特征对11种梅花进行识别,对梅花的识别率较高,但对通用的花卉识别并不适用;白帆等[4]提出基于花朵特征编码分类的植物种类近似识别方法,但没有考虑花蕊区域包含的特征信息,具有一定的局限性。在国外,Nilsback等[5-6]采用视觉词袋来描述花冠的颜色、形状、纹理等方面的特征,在识别的过程中需要优化较多的参数以得到较好的识别率;Chai等[7]提出基于同类花卉形状协同分布的分割算法,并通过提取密集的SIFT特征、兴趣点SIFT特征和整幅图片的Lab特征,计算相应的BoW特征向量,通过SVM分类器实现图像分类;Angelova等[8]采用消除背景干扰信息的方法,在多个样本库的细粒度图像分类实验中都取得了不错的效果。

本文针对花卉色彩丰富、形态各异、特征提取难度较大的实际情况,在提取花卉图像中花冠颜色和形状特征的基础上,创新性地提取花蕊区域的颜色和形状特征,对花卉图像的特征提取和种类识别进行研究,建立特征向量后通过基于SVM算法的分类器进行花卉种类识别。实验结果表明,本文提出的基于多特征融合的识别方法对自建花卉样本库的识别率可以达到92.50%,对通用花卉样本库的识别率为80%,识别效果较好,具有一定的实际应用价值。

1. 花卉图像预处理

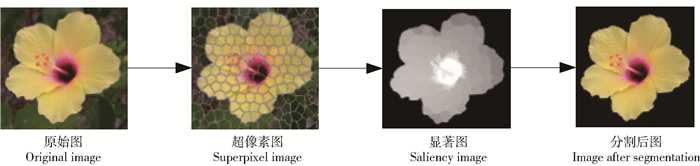

在进行图像识别时,背景干扰信息对识别率影响极大,因此需要对花卉图像进行预处理以提高识别率[9]。花卉形状的确定主要依赖于边缘位置的分割效果[10],本文选取基于显著性检测的Grab Cut花卉图像分割算法,主要步骤是:1)图像超像素区域划分。采用基于简单线性迭代聚类超像素(简称SLIC)算法[11]对原始图像进行超像素区域划分。2)进行显著性检测。采用Yang在2013年提出的基于图的流形排序显著性[12]计算思想,将步骤1)中得到的超像素区域划分块作为相应节点构建连通图,利用流形排序算法对图中的所有节点相关度进行排序,得到原始图像的显著图。3)针对图像的显著性区域,训练花卉图像前景和背景分类的通用模型,利用K-Means算法将图像前景和背景集合分别聚为NF类和NB类,进一步得到均值和协方差;通过最大图-最小割的思想,利用混合高斯参数,得到Gibbs能量函数,实现最优图像分割;迭代使得整个能量函数收敛到最小[13]。通过观察可知,前景花卉颜色相对简单,可将高斯数设为4;背景颜色较前景更加复杂,可将高斯数设为6。图 1为朱槿(Hibiscus rosa-sinensis)的图像分割过程图。

2. 花卉图像特征提取

特征提取是花卉种类识别的关键步骤,特征提取质量直接关系到最终的识别效果。目前常用的花卉特征主要是颜色和形状特征,纹理特征对图像的像素要求较高,使用相对较少。对大多数花卉来说,花冠颜色与花蕊颜色是不同的,因此花蕊区域也包含识别性很强的特征。为了提高花卉种类识别的准确率,本文将花蕊区域特征考虑在内,对花冠颜色、花冠形状、花蕊区域颜色和形状3个方面的特征进行提取。

2.1 花冠颜色特征提取

颜色特征是花卉图像最显著的特征之一,具有形状和方向无关性,适合作为花卉种类识别的依据。由于在进行颜色特征提取时,主要利用图像中主要颜色所占的比例这一特征,颜色所处的位置对特征提取没有影响,因此本文采用具有位置无关性的颜色直方图描述方法进行颜色特征提取[14]。

2.1.1 色彩模型选择

彩色图像有多种颜色空间,RGB色彩空间中亮度信息和颜色信息难以区分,而在HSV(H为色调,S为饱和度,V为亮度)空间中亮度信息和颜色信息彼此独立,对颜色值的采样不受亮度影响。因此需要对原始图像进行颜色空间转换,将RGB颜色空间转换为HSV色彩空间[15]。

2.1.2 HS量化特征提取

由于大部分花卉的花冠颜色相对比较规范,不存在复杂的颜色组合,因此可以提取花冠的主要颜色信息作为颜色特征,确定适合本文图像颜色特征提取的色调饱和度区间划分。在H方向上,分为12个区间;在S方向上,分成10个区间(图 2)。

然后,分别将花卉图像的H通道和S通道按照HS颜色空间的分布进行量化。对H通道,将图 2中的色盘表示的整个圆周等分为12份,从X轴正方向沿圆周逆时针对每一等份从0开始按序标号,h为量化后的图像色调值,其序号用h=⌊H30⌋, H∈[0, 360]表示;对S通道,将图 2中的色盘表示的整个圆从圆心开始,按照等差半径画出10个圆周,沿圆心向圆周方向对每一圆周间部分从0开始按序标号,s为量化后的图像饱和度值,其序号用s=⌊10×S⌋, S∈[0, 1]表示。

包含像素个数最多的区间代表了该区域的主颜色成分,选择分布最多的前3个区域,分别称为第1大区域DC(1)、第2大区域DC(2)和第3大区域DC(3)。根据图像区域各像素的色调值、饱和度值确定其所在的单元,提取区域对应的坐标和所占的比例共9个特征作为参与计算的特征值。这9个特征为:CF1,DC(1)对应的H;CF2,DC(1)对应的S;CF3,DC(1)像素所占的比例(P1);CF4,DC(2)对应的H;CF5,DC(2)对应的S;CF6,DC(2)像素所占的比例(P2);CF7,DC(3)对应的H;CF8,DC(3)对应的S;CF9,DC(3)像素所占的比例(P3)。

2.2 花冠形状特征提取

不同种类的花卉因为花瓣的形状和分布不同而呈现不同的形态,因此花冠的形状是识别花卉种类的另一个显著特征。为提取花冠的形状特征,首先定义整个花冠区域的质心G(gx, gy)为花冠的中心,其坐标计算公式为:

gx=1NN∑i=1xi (1) gy=1NN∑i=1yi (2) 式中:N为花冠边界像素个数,xi为第i个像素的x坐标值,yi为第i个像素的y坐标值。那么花冠中心到每个边界像素的距离计算公式为:

di=√(xi−gx)2+(yi−gy)2 1≤i≤N (3) 不失一般性,将求得的距离按照升序排列,即di≤di+1, 1≤i≤N-1,本文用来描述花冠形状特征的3个特征为花冠锐度SF1,归一化的边界中心距SF2和圆形性SF3。

2.2.1 花冠锐度SF1

花冠锐度可根据花冠边界点到中心的距离的比率得出,计算公式为:

SF1=R10R90 (4) 式中:R10和R90分别为所有有序距离集合中前10%的di和后10%的di的平均值,计算公式为:

R10=10.1N0.1N∑i=1di (5) R90=10.1N0.1N−1∑i=0dN−i (6) 从中可知,特征SF1在花冠残缺或者图像从不同方向获取时变化不会很大。

2.2.2 归一化的边界中心距SF2

该特征为归一化后的所有花冠边界点到中心距离的平均值,计算公式为:

SF2=1NN∑i=1Di (7) 归一化的距离定义为:

Di={1, di≥R90di−R10R90−R10,R10<di<R900, di≤R10 (8) 从特征SF2的定义可知归一化后距离大小不会随图像的大小而改变。

2.2.3 圆形性SF3

该特征表征花冠形状的似圆度,计算公式为:

SF3=4πS′L2 (9) 式中:L为花冠边界的长度,S′为整个花冠区域的面积。当花冠形状接近于圆形时,SF3接近于1。该特征具有缩放、平移和旋转不变性。

至此花冠区域的颜色特征和形状特征提取完毕,花冠区域的特征向量表达式为:

F花冠=[CF1 CF2 ⋯ CF9 SF1 SF2 SF3]T (10) 2.3 花蕊区域特征提取

绝大多数花卉的花蕊位于花朵的中间位置且颜色与花冠有一定差别,因此本文提取花蕊区域特征基于两个基本假设:一是花卉的花蕊区域位于花朵的中央;二是花蕊的主颜色成分与花冠的主颜色成分不同。

为准确提取花蕊区域的识别特征,首先定义一个初始花蕊区域,假设该初始花蕊区域为一个正方形,其中心为花朵的中心,边长为2/3的花瓣长,其中花瓣长度为式(6)定义的R90。假设PDC(1)代表初始花蕊区域的主颜色成分,该颜色应不同于花冠区域的主颜色成分,即DC(1)的颜色。那么我们可以根据PDC(1)定义一个更加准确的花蕊区域:在边长为4/3花瓣长的正方形区域内,所有与PDC(1)颜色相同的区域为准确花蕊区域。与花冠区域颜色和形状特征提取类似,本文将花蕊区域主颜色成分及其所占比例作为花蕊区域的颜色特征,花蕊区域中所有像素到花朵中心点距离的平均值、标准差和三阶中心矩作为花蕊区域的形状特征。

2.3.1 花蕊区域颜色特征提取

与2.1.2中花冠颜色特征提取方法相同,花蕊区域的颜色特征包括:PCF1,最大区域对应的H;PCF2,最大区域对应的S;PCF3,最大区域像素所占的比例(PP1)。

2.3.2 花蕊区域形状特征提取

假设花蕊区域包含M个像素,M个像素的坐标为(pxi, pyi),1≤i≤M。首先定义花蕊区域质心PG (gpx, gpy),其坐标计算公式为:

gpx=1MM∑i=1pxi (11) gpy=1MM∑i=1pyi (12) 那么花蕊区域质心到区域内每个像素的距离的计算公式为:

pdi=√(pxi−gpx)2+(pyi−gpy)2 1≤i≤M (13) 不失一般性,将求得的距离按照升序排列,即pdi≤pdi+1, 1≤i≤M-1。对距离通过等式(14)进行归一化。归一化后可确保形状特征不会随图像的大小而改变。

PDi={1, pdi≥PR90pdi−PR10PR90−PR10,PR10<pdi<PR900, pdi≤PR10 (14) 式中:PR10和PR90分别为所有有序距离集合中前10%的pdi和后10%的pdi的平均值,其计算公式为:

PR10=10.1M0.1M∑i=1pdi (15) PR90=10.1M0.1M−1∑i=0pdM−i (16) 本文用来描述花蕊区域形状特征的3个特征为归一化的距离平均值PSF1,其计算公式为式(17);归一化的距离标准差PSF2,其计算公式为式(18);归一化的距离三阶中心矩PSF3,其计算公式为式(19)。

PSF1=μPD=1MM∑i=1PDi (17) PSF2=σPD(1MM∑i=1(PDi−μPD)2)12 (18) PSF3=m3=(1MM∑i=1(PDi−σPD)3)13 (19) 由此可知花蕊区域的3个形状特征均具有缩放、平移和旋转不变性。至此花蕊区域的颜色特征和形状特征提取完毕,花蕊区域的特征向量表达式为:

F花蕊=[PCF1 PCF2 PCF3 PSF1 PSF2 PSF3]T (20) 则整个花卉的特征向量表达式为:

F=[CF1 CF2 ⋯ CF9 SF1 SF2 SF3 PCF1 PCF2 PCF3 PSF1 PSF2 PSF3]T (21) 3. 分类器设计与参数选择

SVM算法[16]是一种依赖核函数的机器学习分类算法,该算法在解决小样本、非线性以及高维模式识别问题中优势明显,在进行识别实验时受到各种采集条件的影响,难以同时采集到大量所有种类的花卉图像样本,因此本文基于SVM算法建立分类器。

利用SVM算法进行分类时,核函数及其参数的选择是关键步骤,两者的选择情况直接影响到该算法的分类性能。首先通过实验确定核函数,不同核函数的识别率如表 1所示。

表 1 不同核函数下的识别率Table 1. Recognition rate of different kernel functions训练样本

Training sample测试样本

Test sample核函数

Kernel function识别率

Recognition rate/%240 120 线性核函数Linear kernel function 84.17 240 120 多项式核函数Polynomial kernel function 82.50 240 120 Sigmoid核函数Sigmoid kernel function 83.33 240 120 径向基核函数Radial basis kernel function 85.83 由表 1可以看出核函数为径向基函数时识别率相对较高。然后通过交叉验证(cross validation,CV)选择最佳参数。实验中当交叉验证的精度为97.32%时,惩罚系数C=10.628 7,径向基核函数本身参数σ=0.804 361,对自建花卉样本库的识别率从85.83%提高到92.50%。

4. 基于多特征融合的花卉种类识别模型

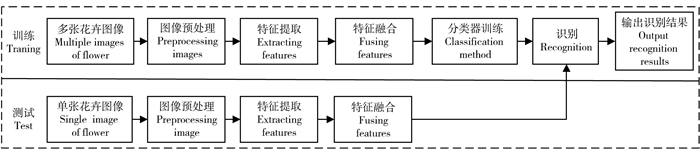

本文将花冠颜色特征、花冠形状特征和花蕊区域特征相融合,基于多特征融合的花卉种类识别模型如图 3所示。

主要步骤分为4个部分:1)图像预处理,将图像中的花朵从复杂背景中分割出来;2)特征提取,对花冠颜色特征、花冠形状特征、花蕊区域特征进行提取;3)特征融合,将步骤2)中提取的特征进行组合,将组合后的的特征向量放入分类器训练和学习;4)分类器识别。

在训练阶段,对得到的多张花卉图像(训练样本)进行图像预处理和特征提取后,形成训练样本综合的特征向量,放入分类器训练学习后形成成熟的训练结果。在测试阶段,对测试样本进行图像预处理和特征提取,将得到的特征值输入分类器识别便可输出花卉类别。

5. 实验与分析

5.1 自建花卉样本库实验与分析

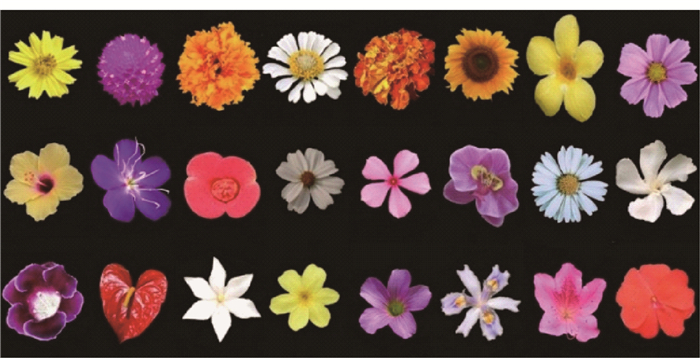

自建花卉样本库采自北京植物园、华南植物园和昆明植物园,通过数码相机等数字图像采集设备有针对性地采集24类花卉图像,每类图像15幅,样本图像的花朵器官有视觉差异且均为正摄图像。首先利用图像处理软件处理成为300×400分辨率的图像,然后经过图像预处理后构建24类花卉图像的数据库。实验中采用了图 4中24类花卉共计360幅图像作为实验样本,每类花卉总样本图像的2/3为训练样本,1/3为测试样本。

对实验样本分别采用K最近邻(KNN)、BP神经网络和SVM算法进行识别,并分别统计其在不同特征组合下的识别率(表 2)。

表 2 不同特征组合基于不同分类器的识别率Table 2. Recognition rate of three different classifiers under different combination of features分类算法Classifying method CF SF PCF PSF CF+SF PCF+PSF CF+SF+PCF CF+SF+PSF CF+SF+PCF+PSF KNN 44.17 78.33 37.50 34.17 81.67 51.67 82.50 84.17 85.00 BP神经网络BP neutral network 52.50 80.83 43.33 36.67 83.33 57.50 85.83 86.67 87.50 SVM 58.33 85.00 46.67 40.83 86.67 63.33 88.33 89.17 92.50 注:CF代表花冠颜色特征,SF代表花冠形状特征,PCF代表花蕊区域颜色特征,PSF代表花蕊区域形状特征。Notes: CF represents corolla color feature, SF represents corolla shape feature, PCF represents color feature in pistil area, PSF represents shape feature in pistil area. 从表 2可知:与KNN和BP神经网络算法相比,SVM算法识别率更高,充分说明了SVM算法在花卉种类识别中具有良好的实用性;在花卉种类识别中,花冠形状特征是进行识别的最主要依据;将特征进行组合后,识别率将有很大的提升;在利用花冠颜色特征和花冠形状特征的基础上,加入花蕊区域特征后识别率有了较大程度的提高。基于花冠颜色特征和花冠形状特征与基于花冠颜色特征、花冠形状特征和花蕊区域特征两种不同方法对每类花卉的识别率如表 3所示。

表 3 不同方法对每类花卉的识别率Table 3. Recognition rate for each class of flower based on different methods类别

Flower species识别率1

Recognition rate 1/%识别率2

Recognition rate 2/%1 100 100 2 100 100 3 80 80 4 80 80 5 80 100 6 100 100 7 60 80 8 100 100 9 60 80 10 100 100 11 80 80 12 80 100 13 100 100 14 100 100 15 80 80 16 80 100 17 100 100 18 100 100 19 80 80 20 40 80 21 100 100 22 100 100 23 100 100 24 80 80 注:识别率1,基于花冠颜色特征与花冠形状特征的识别率;识别率2,基于花冠颜色特征、花冠形状特征和花蕊区域特征的识别率。Notes: recognition rate 1, recognition rate based on color and shape features of corolla region; recognition rate 2, recognition rate based on color and shape features of corolla region and pistil area. 从表 3可知:基于多特征融合的识别方法比基于花冠颜色特征和花冠形状特征的识别方法识别率要高,充分证明了本文所提处的方法的有效性。在实验中发现加入花蕊区域特征前错分率较高的是软枝黄蝉(Allamanda cathartica, 种类7)、朱槿(种类9)和云南黄馨(Jasminum mesnyi, 种类20),3类花卉的对比图如图 5所示。从图中可以看出3类花卉的花冠颜色特征和花冠形状特征相似,单独基于花冠颜色特征和花冠形状特征进行识别,测试样本识别率为66.67%,加入花蕊区域特征后,测试样本识别率为80%。

5.2 通用花卉样本库实验与分析

为测试本文所提出方法的通用性,从牛津大学视觉几何实验室所创建的Oxford 17 flower中选取部分图片作为实验样本。该样本库共有17类,每类80幅,共计1 360幅花卉图片,图片视角变化大,既有近景拍摄也有远景拍摄,且拍摄角度随机。图 6为玛格丽特花(Chrysanthemum frutescens)在不同拍摄角度下的图片。

每类图片选择20张作为训练样本,10张作为测试样本。提取花冠形状特征、花冠颜色特征和花蕊区域特征后,采用SVM分类器进行识别,可得到80%的识别率,明显低于自建样本的识别率,说明本文方法对随机拍摄的不同角度图像识别具有一定的局限性,花冠和花蕊的形状特征受拍摄角度影响较大,造成了识别率的下降。基于Oxford 17 flower样本库,本文方法与已有文献方法的识别率对比结果见表 4。

从表 4可知:本文提出的基于多特征融合的方法识别率略低于文献[8]中方法,高于其他文献所用方法,能够较好地表征花卉特征,花卉种类识别率比较高,具有较强的实用性。

6. 结论与讨论

本文从实际问题出发,针对当前花卉种类识别率低的实际,提出更加适合花卉特征的描述方法,对花卉图像进行预处理后,分别从花冠颜色和花冠形状两个方面提取12个特征,并创新性地提取花蕊区域的6个特征。选择支持向量机算法作为本文的分类算法对花卉进行种类识别,并与传统的K最近邻(KNN)和BP神经网络算法进行比较。实验结果证明基于多特征融合的花卉种类识别方法提高了花卉特征描述的准确性,具有较高的鲁棒性,对自建花卉样本库和通用花卉样本库的花卉种类识别均取得了较好的效果。

本文方法仍存在一定的局限性:1)对花蕊区域的定义和描述还有较大的改进空间;2)在样本选择时,自建花卉样本库中的图像的花朵器官有明显的视觉差异且均为正摄图像,训练出的特征模型代表性不强;3)从通用花卉样本库的实验结果来看本文方法对于颜色形状差异较小、拍摄角度随机的图像的识别率还比较低。不断丰富识别器官,寻找更加准确的特征描述,构建高效稳定的识别模型将是下一步花卉种类识别的3个研究重点。

-

表 1 不同核函数下的识别率

Table 1 Recognition rate of different kernel functions

训练样本

Training sample测试样本

Test sample核函数

Kernel function识别率

Recognition rate/%240 120 线性核函数Linear kernel function 84.17 240 120 多项式核函数Polynomial kernel function 82.50 240 120 Sigmoid核函数Sigmoid kernel function 83.33 240 120 径向基核函数Radial basis kernel function 85.83 表 2 不同特征组合基于不同分类器的识别率

Table 2 Recognition rate of three different classifiers under different combination of features

分类算法Classifying method CF SF PCF PSF CF+SF PCF+PSF CF+SF+PCF CF+SF+PSF CF+SF+PCF+PSF KNN 44.17 78.33 37.50 34.17 81.67 51.67 82.50 84.17 85.00 BP神经网络BP neutral network 52.50 80.83 43.33 36.67 83.33 57.50 85.83 86.67 87.50 SVM 58.33 85.00 46.67 40.83 86.67 63.33 88.33 89.17 92.50 注:CF代表花冠颜色特征,SF代表花冠形状特征,PCF代表花蕊区域颜色特征,PSF代表花蕊区域形状特征。Notes: CF represents corolla color feature, SF represents corolla shape feature, PCF represents color feature in pistil area, PSF represents shape feature in pistil area. 表 3 不同方法对每类花卉的识别率

Table 3 Recognition rate for each class of flower based on different methods

类别

Flower species识别率1

Recognition rate 1/%识别率2

Recognition rate 2/%1 100 100 2 100 100 3 80 80 4 80 80 5 80 100 6 100 100 7 60 80 8 100 100 9 60 80 10 100 100 11 80 80 12 80 100 13 100 100 14 100 100 15 80 80 16 80 100 17 100 100 18 100 100 19 80 80 20 40 80 21 100 100 22 100 100 23 100 100 24 80 80 注:识别率1,基于花冠颜色特征与花冠形状特征的识别率;识别率2,基于花冠颜色特征、花冠形状特征和花蕊区域特征的识别率。Notes: recognition rate 1, recognition rate based on color and shape features of corolla region; recognition rate 2, recognition rate based on color and shape features of corolla region and pistil area. -

[1] 柯逍, 陈小芬, 李绍滋.基于多特征融合的花卉图像检索[J].计算机科学, 2010, 37(11):282-286. doi: 10.3969/j.issn.1002-137X.2010.11.068 KE X, CHEN X F, LI S Z. Flower image retrieval based on multi-features fusion[J]. Computer Science, 2010, 37(11): 282-286. doi: 10.3969/j.issn.1002-137X.2010.11.068

[2] 周伟, 武港山.基于显著图的花卉图像分类算法研究[J].计算机技术与发展, 2011, 21(11):15-18. doi: 10.3969/j.issn.1673-629X.2011.11.005 ZHOU W, WU G S. Research on saliency map based flower image classification algorithm[J]. Computer Technology and Development, 2011, 21(11):15-18. doi: 10.3969/j.issn.1673-629X.2011.11.005

[3] 张娟, 黄心渊.基于图像分析的梅花品种识别研究[J].北京林业大学学报, 2012, 34(1):96-104. http://j.bjfu.edu.cn/article/id/9711 ZHANG J, HUANG X Y. Species identification of Prunus mume based on image analysis[J]. Journal of Beijing Forestry University, 2012, 34(1):96-104. http://j.bjfu.edu.cn/article/id/9711

[4] 白帆, 郑慧峰, 沈平平, 等.基于花朵特征编码归类的植物种类识别方法[J].浙江大学学报(工学版), 2015, 49(10):1902-1908. http://d.old.wanfangdata.com.cn/Periodical/zjdxxb-gx201510011 BAI F, ZHENG H F, SHEN P P, et al. Plant species identification method based on flower feature coding classification[J]. Journal of Zhejiang University(Engineering Science), 2015, 49(10):1902-1908. http://d.old.wanfangdata.com.cn/Periodical/zjdxxb-gx201510011

[5] NILSBACK M E, ZISSERMAN A. Automated flower classification over a large number of classes[C]//Proceedings of Indian Conference on Computer Vision, Graphics & Image Processing. Bhubaneswar: IEEE, 2008: 722-729.

[6] NILSBACK M E, ZISSERMAN A. Delving deeper into the whorl of flower segmentation[J]. Image & Vision Computing, 2010, 28(6):1049-1062. http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=8b2bd882ca3a14c96af35700d88163ca

[7] CHAI Y, LEMPITSKY V, ZISSERMAN A. BiCoS: a Bi-level co-segmentation method for image classification[C]//Proceedings of IEEE International Conference on Computer Vision. Barcelona: IEEE, 2011: 2579-2586.

[8] ANGELOVA A, ZHU S. Efficient object detection and segmentation for fine-grained recognition[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington: IEEE Computer Society, 2013: 811-818.

[9] YANIKOGLU B, YANIKOGLU B, APTOULA E, et al. Sabanci-Okan system at ImageClef 2012: combining features and classifiers for plant identification[C]. Rome: CLEF, 2012.

[10] 王丽君, 淮永建, 彭月橙.基于叶片图像多特征融合的观叶植物种类识别[J].北京林业大学学报, 2015, 37(1):55-61. doi: 10.13332/j.cnki.jbfu.2015.01.006 WANG L J, HUAI Y J, PENG Y C. Method of identification of foliage from plants based on extraction of multiple features of leaf images[J]. Journal of Beijing Forestry University, 2015, 37(1):55-61. doi: 10.13332/j.cnki.jbfu.2015.01.006

[11] ACHANTA R, SHAJI A, SMITH K, et al. SLIC superpixels compared to state-of-the-art superpixel methods.[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2012, 34(11):2274-2282. http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=218e2dd693ea07f7be3f296ed4e6aaba

[12] YANG C, ZHANG L, LU H, et al. Saliency detection via graph-based manifold ranking[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Washington: IEEE Computer Society, 2013: 3166-3173.

[13] ROTHER C, KOLMOGOROV V, BLAKE A. GrabCut: interactive foreground extraction using iterated graph cuts[J]. Acm Transactions on Graphics, 2004, 23(3):309-314. doi: 10.1145/1015706.1015720

[14] 裴勇.基于数字图像的花卉种类识别技术研究[D].北京: 北京林业大学, 2011. http://cdmd.cnki.com.cn/Article/CDMD-10022-1011134451.htm PEI Y. Study on the flower identification technology with digital images[D].Beijing: Beijing Forestry University, 2011. http://cdmd.cnki.com.cn/Article/CDMD-10022-1011134451.htm

[15] GONZALEZ R C, WINTZ P. Digital image processing[J]. Prentice Hall International, 2002, 28(4):484-486. http://d.old.wanfangdata.com.cn/Periodical/bjykdxxx201601025

[16] 张学工.关于统计学习理论与支持向量机[J].自动化学报, 2000, 26(1):32-42. doi: 10.3969/j.issn.1003-8930.2000.01.008 ZHANG X G. Introduction to statistical learning theory and support vector machines[J]. Acta Automatica Sinica, 2000, 26(1):32-42. doi: 10.3969/j.issn.1003-8930.2000.01.008

-

期刊类型引用(11)

1. 李鑫磊,杨传颖,石宝,敖乐根. 基于深度哈希与注意力机制的花卉图像检索. 计算机仿真. 2024(02): 207-211+532 .  百度学术

百度学术

2. 陈泽伟,乔印虎,周玉蝶. 基于机器视觉的白芍药材双面品质检测系统. 常州工学院学报. 2024(02): 1-7 .  百度学术

百度学术

3. 崔艳荣,卞珍怡,高英宁. 基于生成对抗网络的花卉识别方法. 江苏农业科学. 2022(22): 200-208 .  百度学术

百度学术

4. 何进荣,任维鑫,石延新,白宗文. 基于卷积神经网络的牡丹花品种识别. 系统仿真技术. 2021(02): 128-133 .  百度学术

百度学术

5. 吴丽娜,王林山. 改进的LeNet-5模型在花卉识别中的应用. 计算机工程与设计. 2020(03): 850-855 .  百度学术

百度学术

6. 黄清梅,杨晓洪,侯瑶,刘艳芳,吕宏斌. 显色图像分析技术在水稻叶耳花青甙显色目测分级中的应用. 食品安全质量检测学报. 2020(07): 2050-2056 .  百度学术

百度学术

7. 任意平,夏国强,李俊丽. 基于花蕊区域定位的花卉识别方法. 电子测量技术. 2020(07): 97-102 .  百度学术

百度学术

8. 李晓红,吴仲华,刘海秋,马慧敏. 基于卷积神经网络模型的多肉植物种类识别. 贵州师范学院学报. 2020(03): 9-15 .  百度学术

百度学术

9. 刘嘉政. 基于深度迁移学习模型的花卉种类识别. 江苏农业科学. 2019(20): 231-236 .  百度学术

百度学术

10. 刘文定,李安琪,张军国,谢将剑,鲍伟东. 基于ROI-CNN的赛罕乌拉国家级自然保护区陆生野生动物自动识别. 北京林业大学学报. 2018(08): 123-131 .  本站查看

本站查看

11. 张彤,刘志,庄新卿. 基于开发者平台和深度学习的智能识花与护花系统. 工业控制计算机. 2018(01): 90-92 .  百度学术

百度学术

其他类型引用(11)

下载:

下载: